FrugalGPT

理由

Frugal 是节俭的意思。 https://arxiv.org/abs/2305.05176

一样是用 api,能不能少花一些钱做同样的事情呢?

輸入:0.03$ / 1000 tokens

輸出:0.06$ / 1000 tokens

假設每次使用輸入 1000 tokens 、輸出 1000 tokens,每次使用需要 0.03$+0.06$ = 0.09$ (2.78 新台幣)

桃市府試驗以ChatGPT分析1999陳情案件,「1999臺北市民當家熱線」平均每月服務 15 萬 7,522 通電話

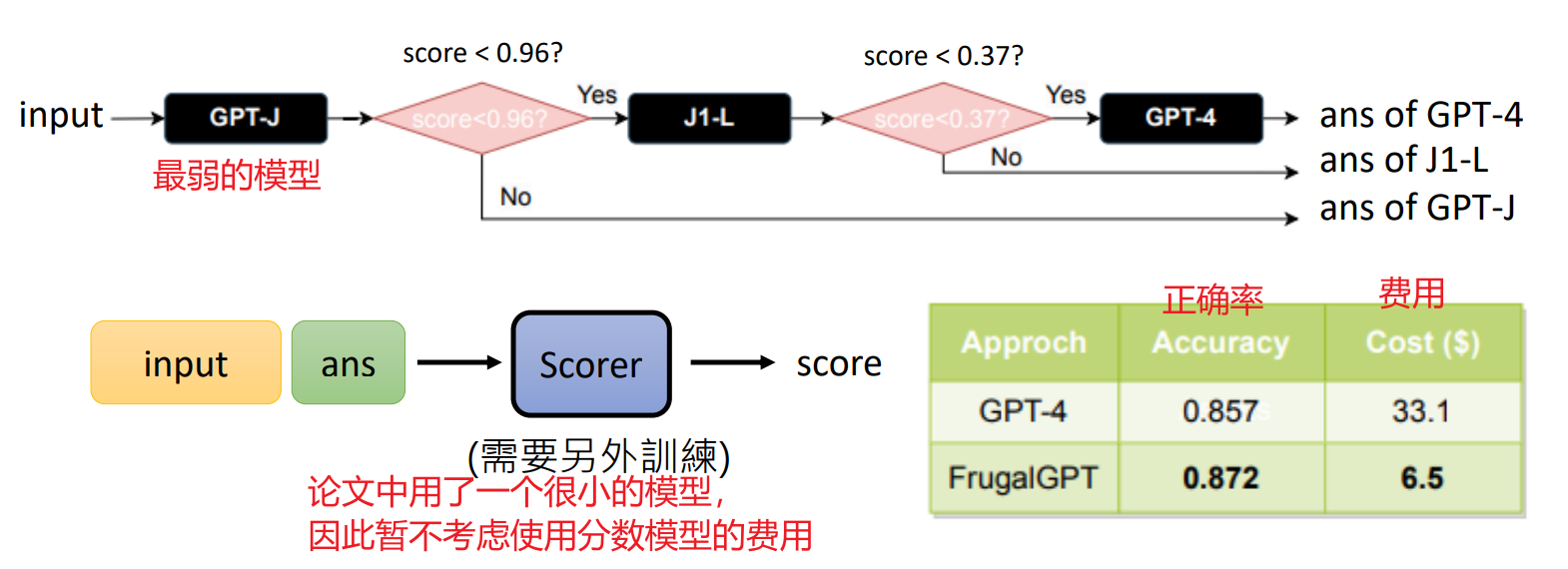

方法

介绍了三种方法,只有第三种方法做了实验

方法一

方法一: Prompt Adaptation (縮短輸入)

In-context learning 原先用两个例子,如果仅用一个例子也能达到差不多的结果,则可以减少成一个例子,这个方法叫 Prompt Selection。

还有一种方法,叫 Query Concatenation,是将原先分开问的问题接在一起。这里省钱的原因在于,本来分开问时 In-context Learning 里的例子会被使用多次,而将新问题接在一块后,该例子就只用一次。

方法二

方法二: LLM Approximation (自建模型)

Completion Cache:把问过 ChatGPT 的问答都存在 database 里,之后遇到新问题先去 database 里看有没有类似的问题,假如有,直接将相关答案拿出来而不用再 call ChatGPT了

方法三

模型不同收费不同

收费面向不同:根据输入长度收费、根据输出长度收费、根据调用次数收费

可以综合应用不同模型,理由是:

殺雞不用牛刀

簡單的問題交給比較弱 (比 較便宜) 的模型

只有難的問題才給比較強 (比較貴) 的模型

不同模型的能力可能可以互補

GPT-4 确实是最强的,但在一小部分特定任务上,也会比不上其它模型。

看不懂